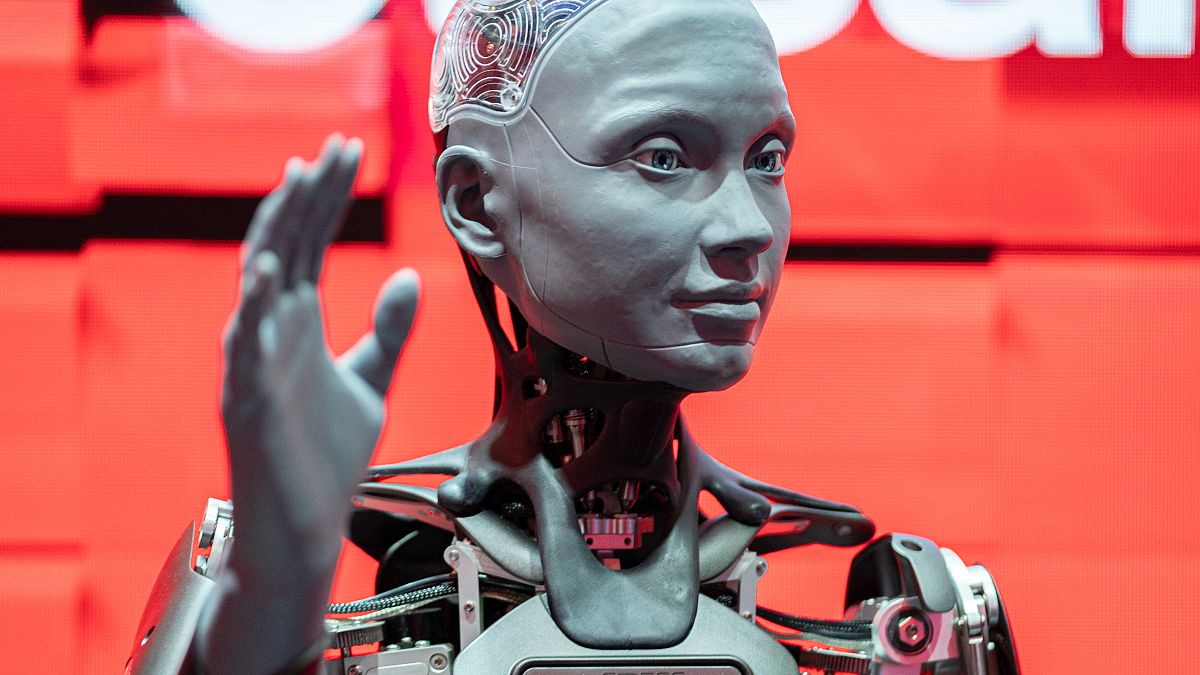

Une utilisation excessive des robots pourrait entraîner des préjugés, de la panique ou simplement de mauvais conseils, s’inquiètent les responsables.

La Commission européenne s’inquiète de l’impact de l’utilisation de l’intelligence artificielle (IA) sur les marchés de la banque, de l’assurance et des valeurs mobilières, selon une consultation publiée aujourd’hui (18 juin).

L’UE vient d’adopter une vaste loi sur l’IA, devenant ainsi la première juridiction au monde à légiférer pour rendre la technologie émergente sûre et non discriminatoire.

Mais les responsables se demandent maintenant s’il faudrait davantage d’orientations pour que les règles s’adaptent au secteur financier – un domaine déjà soumis à des exigences réglementaires strictes et où le coût d’une erreur pourrait être élevé.

« La loi européenne sur l’IA et les règles existantes du secteur financier fournissent une base solide pour permettre l’innovation technologique », a déclaré Mairead McGuinness, la commissaire européenne chargée des services financiers, dans un communiqué, appelant les citoyens à partager leurs points de vue sur un « environnement en évolution rapide et en constante évolution ». domaine de plus en plus important du progrès technologique ».

La nouvelle loi européenne sur la technologie, qui devrait s’appliquer à partir de mai 2025, s’appliquerait à l’ensemble de l’économie, mais impose une surveillance supplémentaire aux outils automatisés utilisés dans les secteurs à plus haut risque tels que la santé, les forces de l’ordre et le recrutement.

Vérifications de crédit

Les applications financières sensibles, comme l’évaluation de la solvabilité d’une personne, sont également signalées comme nécessitant potentiellement des lois ou des orientations plus détaillées.

Ce ne serait pas la première fois que les responsables bruxellois se montrent prudents quant à la manière dont la technologie est utilisée dans le secteur financier.

En 2022, l’UE a adopté de nouvelles règles connues sous le nom de Digital Operational Resilience Act, DORA, compte tenu des craintes que le recours par les banques à une petite poignée de fournisseurs de cloud computing non réglementés puisse entraîner des violations de données ou une panique du marché.

De même, la Commission semble s’inquiéter de la perspective d’un « regroupement » – lorsque plusieurs financiers s’appuient tous sur les mêmes systèmes informatiques pour prendre des décisions commerciales.

Les fluctuations exagérées des prix ou la concentration du marché qui en résulteraient pourraient constituer un risque pour les marchés financiers – ou les robots pourraient tout simplement donner des réponses erronées, indique le document de consultation.

Absurdité?

« L’IA à usage général (…) peut parfois produire des ‘hallucinations’, c’est-à-dire des réponses absurdes ou inexactes », a-t-il déclaré.

C’est un phénomène familier à quiconque tente d’obtenir une réponse claire de ChatGPT – mais cela poserait également des problèmes aux robots-financiers, compte tenu de leur obligation légale de donner des conseils corrects dans le meilleur intérêt de leurs clients.

L’IA pourrait avoir des effets bénéfiques, a déclaré la Commission, par exemple en détectant des activités commerciales douteuses qui pourraient indiquer un abus de marché. Mais les responsables semblent également préoccupés par les ensembles de données d’IA mal formés, qui conduisent à une discrimination généralisée.

En 201, la plus haute juridiction de l’UE a déclaré qu’il était illégal de facturer davantage aux hommes pour l’assurance automobile. Mais un algorithme de tarification pourrait signifier que les personnes d’un sexe ou d’une race particulière finiraient par payer plus, sans qu’aucun humain ne puisse expliquer pourquoi.